Porównanie LLM: Tekst, Kod & Modele SI 2025 wyjaśnione w przystępny sposób

W świecie Sztucznej Inteligencji (SI) Duże Modele Językowe (LLM) stanowią centralny element. Generują tekst, kod, analizy i dialogi – i znacznie różnią się pod względem mocnych stron, zastosowania i licencji. W tym artykule znajdziesz aktualne porównanie LLM, ważnych dostawców, scenariusze użycia oraz konkretne wskazówki, jak rozpocząć eksperymentowanie z nimi.

Artemis (Tetris Clone)

DIVION – Astro Edition

Zeichne Grenzen, decke Weltraumfotos frei. 25 Level, Sound von nuonu, Bilder der Sternenfreunde Wurmannsquick.

Czym są LLM? – Podstawy

Duży Model Językowy (LLM) jest trenowany na ogromnych zbiorach danych tekstowych i kodowych. Uczy się relacji między słowami, składni i koncepcji, dzięki czemu może generować nowe treści, odpowiadać na pytania, pisać kod lub analizować istniejące teksty.

Powstanie & Architektura

- Gromadzenie & Wstępne Przetwarzanie Danych – Teksty, fora, publikacje naukowe, repozytoria kodu są zbierane i czyszczone.

- Trening & Dostrajanie – Model uczy się prawdopodobieństw, częstych wzorców, struktur logicznych; następnie następuje dostrajanie i warstwy bezpieczeństwa (np. RLHF).

- Ocena & Publikacja – Testy na benchmarkach, kontrola stronniczości i halucynacji; wdrożenie poprzez chmurę, API lub lokalnie.

Jak używać LLM? Online, lokalnie & przez API

Online / Chmura

Używasz modelu za pośrednictwem usług internetowych lub platform. Zaleta: najnowsze wersje, łatwość użycia. Wada: możliwe kwestie prywatności danych, zależność od dostawcy.

Offline / lokalnie

Model działa na Twoim własnym systemie. Zaleta: maksymalna kontrola, prywatność danych, niższe opóźnienia. Wada: wymagania sprzętowe i konfiguracja. Projekty takie jak OpenAI gpt-oss po raz pierwszy umożliwiają uruchamianie modeli z otwartymi wagami lokalnie.

Przez API / Integracja

Dzięki API możesz wbudować funkcje SI we własne narzędzia, aplikacje lub systemy backendowe. Jest to idealne rozwiązanie do automatyzacji, agentów lub niestandardowych przepływów pracy.

LLM a systemy klasyczne (wyszukiwarki, encyklopedie)

Wyszukiwarki dostarczają istniejące treści i linki do źródeł. LLM generuje nowe odpowiedzi na podstawie swojej nabytej wiedzy – z ryzykiem błędów (halucynacji). Dlatego: zawsze krytycznie weryfikuj, w razie potrzeby korzystaj np. z odnośników do źródeł.

Nowości & Trendy 2025 w obszarze LLM

- GPT-4.5 & GPT-4.1 od OpenAI: lepsza jakość tekstu, silniejsze rozumienie kontekstu i bardziej kreatywne odpowiedzi. (OpenAI GPT-4.5)

- Modele Open-Weight (gpt-oss): po raz pierwszy modele OpenAI z otwartymi wagami, które można uruchamiać lokalnie. (Źródło artykułu: Wired o wydaniu Open-Weight)

- Zaawansowane możliwości Claude: Claude może teraz tworzyć i edytować pliki (Excel, DOCX, PDF) oraz korzystać z zewnętrznych narzędzi. (Anthropic News: Claude tworzy pliki, Użycie narzędzi w Claude)

- Multimodalność: Modele takie jak GPT-4 akceptują tekst & obrazy jako dane wejściowe. (Badania OpenAI GPT-4)

- Hybrydowe / nowatorskie architektury: Modele takie jak Falcon-H1 łączą wydajność z możliwością długiego kontekstu.

- Modele regionalne / domenowe: Mniejsze, wyspecjalizowane LLM dla medycyny, prawa, języków lokalnych itp. stają się bardziej dostępne.

Przypadki użycia: Gdzie LLM są dziś sensownie stosowane

- Tworzenie tekstów & treści: Posty na blogu, teksty produktów, warianty marketingowe, newslettery.

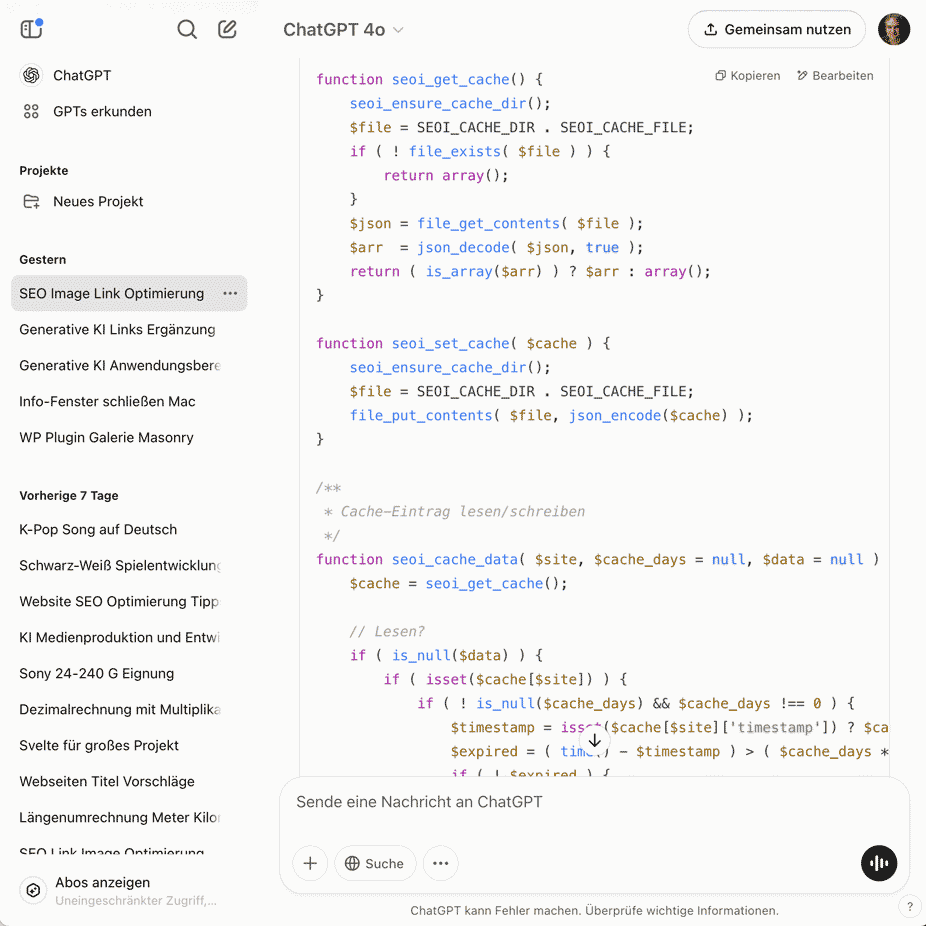

- Pomoc w programowaniu & generowanie kodu: Fragmenty kodu, refaktoryzacja, testy, dokumentacja, debugowanie.

- Streszczenia & analiza: Strukturyzowanie dużych tekstów, wydobywanie kluczowych informacji, kategoryzowanie tematów.

- Badania & generowanie pomysłów: Pytania badawcze, podejścia, dane kontekstowe.

- Systemy dialogowe / wirtualni asystenci: Chatboty, agenci wsparcia, asystenci spotkań.

- Lokalizacja & tłumaczenie: tłumaczenia uwzględniające kontekst, wersje dostosowane kulturowo.

- Specjalistyczna pomoc: Umowy, kwestie prawne, medyczne – z weryfikacją przez człowieka.

- Automatyzacja & agenci: Przepływy pracy, API, zadania wsadowe, procesy wieloetapowe.

Wybrani dostawcy & modele w porównaniu

Uwaga: Ten wybór jest przykładowy i ma na celu pomóc Ci odkryć oferty – nie stanowi ostatecznej rekomendacji.

OpenAI / Rodzina GPT

OpenAI oferuje szeroki zakres możliwości dzięki GPT-4 i nowszym wariantom — m.in. multimodalność, dostęp do API i integracje. (Strona główna OpenAI)

Dokumentacja API tutaj: Dokumentacja API OpenAI GPT

Anthropic / Claude

Claude kładzie duży nacisk na bezpieczeństwo, integrację narzędzi i łatwość użytkowania. Nowsze wersje obsługują operacje na plikach i dostęp do narzędzi. (Claude w Anthropic)

Więcej o Claude dla biznesu: Claude for Work

Meta / LLaMA & Modele Open Source

Meta regularnie wydaje nowe wersje LLaMA (np. LLaMA 4) jako model open source do lokalnego użytku i dostosowywania.

Mistral, DeepSeek & Modele Specjalistyczne

Mistral oferuje wydajne modele z wariantami Open-Weight. DeepSeek (np. DeepSeek-R1 / V-Series) koncentruje się na rozumowaniu. Modele domenowe (medycyna, prawo, język) zyskują na znaczeniu.

Modele Falcon & Podejścia Hybrydowe

Projekty takie jak Falcon-H1 prezentują nowe podejścia architektoniczne, które łączą wydajność z zachowaniem kontekstu.

Jak znaleźć swój idealny LLM – Lista kontrolna

- Co chcesz osiągnąć? (Tekst, kod, analiza, agenci…)

- Jaki zakres kontekstu / złożoność danych wejściowych?

- Czy potrzebna jest multimodalność (obraz / audio)?

- Prywatność danych / lokalnie vs chmura?

- Open Source vs własnościowe / koszty licencji?

- Wymagania jakościowe vs kreatywność?

- Integracja techniczna (API / narzędzia)?

Zachęta: Testuj samodzielnie & ucz się

Wielu dostawców oferuje bezpłatne wersje próbne lub ograniczoną darmową użyteczność. Rozpocznij od małych projektów (np. tekst na bloga, test promptu, skrypt kodu), porównaj wyniki i znajdź swój idealny model do swojej aplikacji.

Dodatkowe zasoby:

Przykłady generatywnej SI w obszarze tekstu i kodu

Tworzenie tekstów & automatyzacja: Niezależnie od tego, czy są to artykuły na bloga, kreatywne historie, teksty piosenek czy e-maile biznesowe – modele SI mogą efektywnie tworzyć treści w różnych stylach. Nadają się do content marketingu, pracy redakcyjnej i mediów społecznościowych. Szczególnie w obsłudze klienta, odpowiedzi generowane przez SI są wykorzystywane do automatycznego przetwarzania zapytań i optymalizacji FAQ.

Generowanie kodu & rozwój oprogramowania: SI może pomóc w pisaniu złożonych algorytmów, znajdowaniu błędów lub bezpośrednim generowaniu funkcjonalnego kodu dla aplikacji internetowych i wtyczek. Deweloperzy mogą korzystać z sugestii opartych na SI w celu optymalizacji i zwiększenia efektywności fragmentów kodu. Szczególnie w rozwoju aplikacji i gier, SI może automatyzować powtarzalne zadania, pozostawiając więcej czasu na procesy kreatywne.

Analiza danych & przetwarzanie informacji: Oprócz pisania, SI może również analizować, strukturyzować i oceniać ogromne ilości danych – od tabel po teksty naukowe i dokumentacje techniczne. Firmy wykorzystują SI do analizy rynku, przewidywania trendów lub optymalizacji raportów finansowych. Naukowcy stosują modele SI do przeprowadzania złożonych analiz statystycznych lub odkrywania zależności w dużych zbiorach danych.

Automatyczne tłumaczenia & przetwarzanie języka: Modele językowe rewolucjonizują obszar automatycznych tłumaczeń. Nowoczesne systemy SI mogą tłumaczyć nie tylko proste teksty, ale także uwzględniać aspekty kulturowe i kontekstowe. Jest to szczególnie przydatne w międzynarodowych firmach, przy lokalizacji treści lub w komunikacji dostępnej dla wszystkich.

Wirtualni asystenci & systemy dialogowe: Chatboty i asystenci głosowi, tacy jak ChatGPT, są już ugruntowani w wielu obszarach. Pomagają nie tylko w obsłudze klienta, ale także w wewnętrznej komunikacji firm. Asystenci wspierani przez SI mogą protokołować spotkania, zarządzać kalendarzami lub wspierać kreatywne sesje burzy mózgów.

Automatyczne streszczenia & analiza tekstu: SI może przekształcać długie teksty lub artykuły w krótkie, zrozumiałe streszczenia. Ułatwia to przyswajanie informacji w redakcjach wiadomości, pracach naukowych czy dokumentach prawnych. Szczególnie w badaniach naukowych i dziedzinie prawa, możliwość automatycznego wyróżniania istotnych fragmentów to ogromna oszczędność czasu.

Personalizacja & systemy rekomendacji: Generatywna SI odgrywa kluczową rolę w personalizacji treści tekstowych. Serwisy informacyjne lub platformy online dostosowują artykuły, reklamy i powiadomienia indywidualnie do zainteresowań czytelników. Firmy wykorzystują SI do tworzenia spersonalizowanych opisów produktów lub tekstów marketingowych.

Prawo & umowy: Kancelarie prawne i firmy wykorzystują SI do analizy i tworzenia umów. SI może identyfikować klauzule, oceniać ryzyka prawne lub automatycznie dostosowywać umowy do obowiązujących przepisów. Oszczędza to czas i zmniejsza ryzyko błędów ludzkich.

Te przykłady pokazują, że generatywna SI odgrywa coraz ważniejszą rolę nie tylko w obszarze kreatywnym, ale także w wielu dziedzinach gospodarczych i naukowych. Dzięki ciągłemu rozwojowi tych technologii, ich wpływ będzie w przyszłości jeszcze większy.

Przegląd dostawców tekstów & kodu AI oraz LLM

OpenAI

OpenAI oferuje GPT-4 (8k/32k), wysoce zaawansowany model językowy, który wyróżnia się doskonałą wydajnością w złożonych zadaniach i rozszerzonym rozumieniem kontekstu. Do zalet należą imponująca moc obliczeniowa i zdolność do przetwarzania dużych ilości informacji.

Jako rozwiązanie zamknięte (closed-source), model podlega jednak komercyjnym warunkom licencyjnym, co ogranicza bezpłatne użytkowanie. Ponadto, trening opiera się na danych do września 2021 roku.

Więcej informacji: OpenAI

o1 (w tym o1.ai)

Grupa o1 dostarcza LLM, które są dostępne w różnych wariantach – od modeli na poziomie doktoranckim, przez kompaktowe, niedrogie wersje, po wydajne warianty o wysokiej wydajności.

Umożliwia to zastosowanie w różnorodnych scenariuszach, zawsze stawiając na wysoką wydajność i efektywność. Jako produkty zamknięte (closed-source), modele te nie są jednak swobodnie dostępne, co należy wziąć pod uwagę przy bezpłatnym użytkowaniu.

Więcej informacji: o1

o3

Seria o3 koncentruje się na zaawansowanych zdolnościach myślenia i kodowania. Dzięki ofertom obejmującym zarówno potężne, jak i kompaktowe warianty (takie jak o3, o3 mini i o3‑mini), o3 kieruje się do użytkowników, którzy potrzebują elastycznych rozwiązań do wymagających zastosowań.

Jednakże zamknięty kod źródłowy ogranicza otwarty dostęp i swobodny rozwój, co należy uznać za wadę.

Więcej informacji: o3

Dzięki Gemini 1.5 Pro, Google dostarcza multimodalny LLM, który jest w stanie przetwarzać informacje tekstowe i wizualne. Głęboka integracja z infrastrukturą Google i wszechstronne możliwości zastosowania oferują wyraźne korzyści.

Jako model zamknięty (closed-source), Gemini jest jednak ograniczony w swobodnym użytkowaniu i często związany z warunkami komercyjnymi.

Więcej informacji: Google AI

Anthropic

Anthropic stawia na wysoką wydajność w Claude 3.5 Sonnet, co znajduje odzwierciedlenie w silnych wynikach benchmarków. Szczególny nacisk kładziony jest na bezpieczeństwo i etycznie uzasadnione odpowiedzi.

Jednakże zamknięty charakter kodu źródłowego ogranicza przejrzysty dostęp i może prowadzić do płatnych modeli użytkowania.

Więcej informacji: Anthropic

DeepSeek

DeepSeek imponuje swoimi rozwiązaniami open source (DeepSeek‑R1 i DeepSeek‑V3), które bazują na innowacyjnej architekturze MoE i oferują wyjątkowe zdolności rozumowania – na przykład w przetwarzaniu treści chińskich i zadań matematycznych.

Otwarty kod źródłowy umożliwia dostosowania i swobodny dostęp, choć niektóre wersje (takie jak DeepSeek‑V3) mogą wiązać się z ograniczeniami użytkowania.

Więcej informacji: DeepSeek

Grok od xAI

xAI Elona Muska prezentuje Grok‑2, potężny LLM, który w niektórych metrykach może nawet przewyższać GPT‑4. Model ten jest skierowany do użytkowników poszukujących maksymalnej wydajności w specjalistycznych zastosowaniach. W połowie lutego 2025 roku zaprezentowano Grok-3, który ma ambicje stać się jednym z najlepszych LLM na rynku.

Więcej informacji: Grok

Meta

Dzięki LLaMA 3.2, Meta oferuje rozwiązanie open source, które wyróżnia się ulepszonymi zdolnościami rozumowania i kodowania. Swobodna dostępność umożliwia deweloperom dostosowanie modelu i integrację go z różnymi aplikacjami.

Jednakże produktywne zastosowanie wymaga wiedzy technicznej i odpowiedniej infrastruktury.

Więcej informacji: Meta AI

Mistral AI

Mistral AI imponuje Mixtral 8x7B, modelem open source, który dzięki wydajnej architekturze MoE działa oszczędnie pod względem zasobów. Model ten oferuje elastyczne i ekonomiczne rozwiązanie, choć stosunkowo mniejszy rozmiar modelu może wiązać się z ograniczeniami w niektórych scenariuszach zastosowań.

Więcej informacji: Mistral AI

Hugging Face

Hugging Face to nie LLM, lecz platforma, która udostępnia różnorodne modele LLM open source oraz narzędzia do ich rozwoju i użytkowania. Oferuje dostęp do modeli takich jak BERT, RoBERTa i wielu innych, które zostały opracowane przez społeczność.

Więcej informacji: Hugging Face

Cohere

Cohere oferuje szereg LLM dla różnych obszarów zastosowań, w tym generowanie tekstu, streszczanie i wyszukiwanie semantyczne. Ich modele są dostępne poprzez API i mogą być integrowane z różnymi aplikacjami.

Więcej informacji: Cohere

Amazon Web Services (AWS)

AWS oferuje Amazon Bedrock, platformę, która umożliwia dostęp do różnych LLM od dostawców zewnętrznych (takich jak Anthropic, AI21 Labs i Stability AI) oraz do własnych modeli (takich jak Amazon Titan).

Więcej informacji: Amazon Bedrock